Kujuta ette, et Euroopa Liidu värske tehisaru seadus (inglise keeles AI Act) ei olegi keeruline juriidiline peavalu, vaid hoopis nagu liikluseeskiri uuele ja kihavale tehnoloogiamaantele. Selle peamine mõte on tegelikult lihtne ja loogiline: mida rohkem võib üks tehisaru lahendus inimese elu mõjutada, seda selgemad peavad olema selle kasutamise reeglid.

EL Tehisaru Akt – Sisukord

Sissejuhatus: EL Tehisaru Akt – mida see Eesti ettevõttele tähendab 2026. aastal

Selle postituse eesmärk on tõlkida AI Act sinu jaoks lihtsasse keelde. Teeme selgeks, mis on need kuulsad riskikategooriad, millised kohustused võivad sinu ettevõttele tekkida ja milliseid praktilisi samme peaksid juba täna astuma, et 2026. aastal muretult edasi tegutseda.

Pea meeles põhisõnumit: AI Act on riskipõhine. Mida suurem on tehisaru mõju inimeste õigustele ja turvalisusele, seda rangemad on ka nõuded. Ja just seetõttu on tark juba praegu end teemaga kurssi viia.

AI Act 60 sekundiga: riskipõhine loogika (mida pead mõistma)

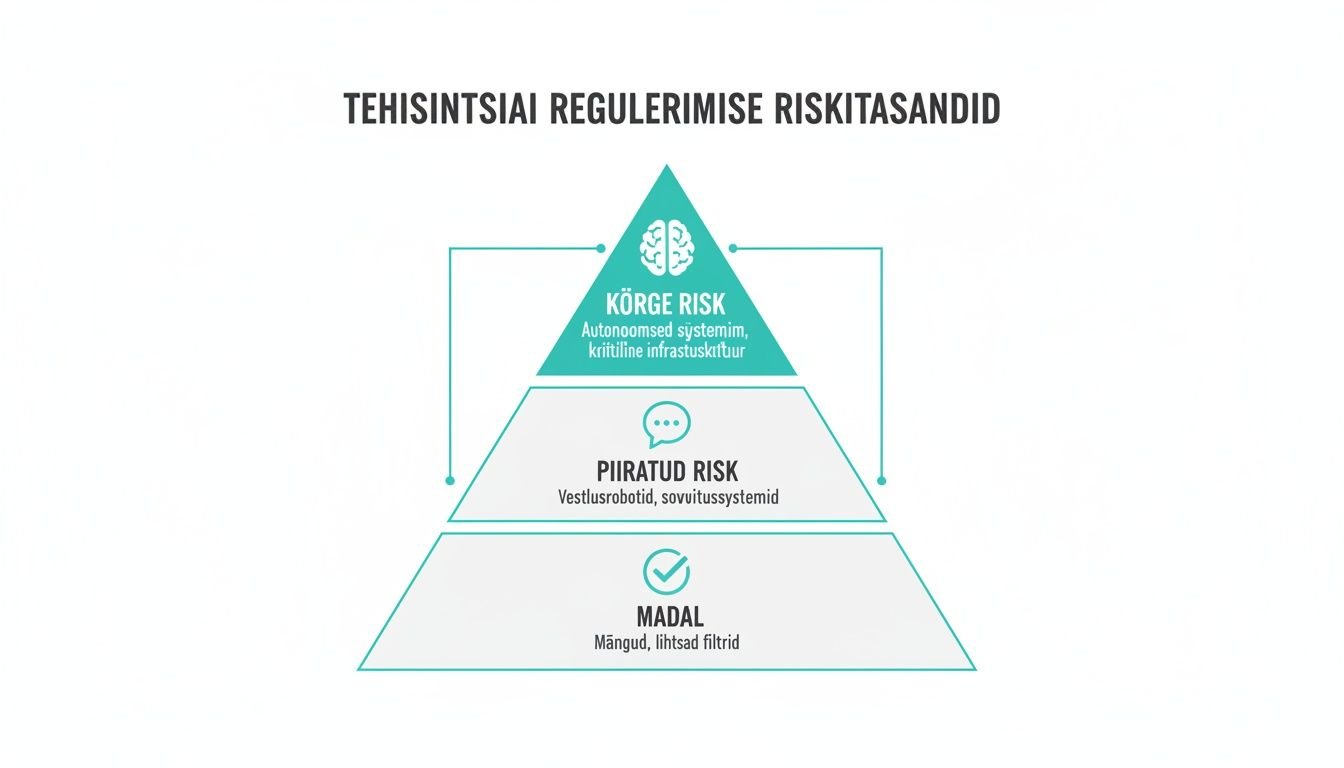

Kogu seaduse loogika taandub riskitasemetele. Mõtle sellest nagu foorituledest – mõned asjad on rangelt keelatud (punane tuli), teised nõuavad erilist tähelepanu (kollane tuli) ja suur osa saab vabalt edasi liikuda (roheline tuli).

Neli riskitaset (lihtsalt ja selgelt)

- Vastuvõetamatu risk (Keelatud): Teatud tehisaru praktikad on täielikult keelatud, sest need lähevad vastuollu Euroopa põhiväärtustega. Näiteks inimeste sotsiaalne skoorimine riigi poolt või teadlikult kahju tekitavad manipulatiivsed süsteemid.

- Kõrge risk: Need on süsteemid, mis võivad inimeste elu oluliselt mõjutada (näiteks tööle värbamine, laenuotsused, haridus). Nende kasutamine on lubatud, aga reeglid on karmid: nõutakse põhjalikku dokumentatsiooni, riskijuhtimist, kvaliteedikontrolli ja inimjärelevalvet.

- Piiratud risk: Siin on võtmesõnaks läbipaistvus. Kui klient suhtleb juturobotiga, peab ta sellest teadma. Kui sisu on loodud tehisaru abil, peab see olema märgistatud.

- Minimaalne risk: Enamik igapäevaseid AI rakendusi, nagu rämpspostifiltrid või soovitussüsteemid e-poes. Nendele seadus uusi kohustusi juurde ei too.

Näiteks, kui kasutad tehisaru oma laos inventuuri tegemiseks, on see minimaalne risk. Kui aga sama tehisaru hakkab analüüsima töötajate tootlikkust ja tegema selle põhjal ettepanekuid vallandamiseks, liigume juba kõrge riski alale.

Kaks rolli, mida pead eristama: pakkuja vs. kasutaja

Seadus eristab kahte peamist rolli ja sinu kohustused sõltuvad sellest, kumb sa oled.

- Pakkuja (provider): See on ettevõte, kes arendab AI-süsteemi ja toob selle turule või võtab kasutusele oma nime all. Näiteks tarkvarafirma, kes ehitab tehisarul põhineva värbamistööriista.

- Kasutaja (deployer): See on ettevõte, kes kasutab valmis AI-süsteemi oma igapäevatöös. Näiteks personaliosakond, kes kasutab seda sama värbamistööriista CV-de sõelumiseks.

Miks see vahe oluline on? Sest vastutus ja kohustused on nende kahe rolli vahel jaotatud. Pakkuja vastutab selle eest, et süsteem oleks ehitatud reeglitele vastavalt, ja kasutaja vastutab selle eest, et süsteemi kasutataks õigesti ja inimjärelevalve all.

Mis osa AI Actist puudutab “tavalist” Eesti ettevõtet kõige sagedamini?

Kuigi kõrge riskiga süsteemid saavad kõige rohkem tähelepanu, puudutab enamikku Eesti ettevõtteid esialgu üks palju lihtsam teema – läbipaistvus. See on miski, millega saad tegeleda juba täna, ilma juristide armeeta.

Läbipaistvuse kohustused (Artikkel 50): teavita, märgista, tee arusaadavaks

Artikkel 50 on sinu jaoks kõige praktilisem osa seadusest. See ütleb lihtsalt:

- Kui inimene suhtleb AI-ga, anna talle sellest teada. Kui su veebilehel on juturobot, peab külastaja aru saama, et ta ei vestle päris inimesega.

- Märgista AI-ga loodud sisu. Kui lood või muudad tehisaruga pilte, videot või heli (eriti deepfake’e ehk süvavõltsinguid), peab see olema selgelt märgistatud kui tehislik. See aitab vältida eksitamist.

- Informeeri eritehnoloogiatest. Kui kasutad näiteks emotsioonituvastust või biomeetrilist analüüsi, peab inimene olema teavitatud, et selline süsteem töötab.

Näiteks, kui postitad sotsiaalmeediasse tehisaru loodud pildi, mis kujutab sinu meeskonda fantaasiamaailmas, lisa pildiallkirja märge “Loodud tehisaruga”. See ongi juba samm õiges suunas.

Kõrge riskiga kasutusvaldkonnad, mis võivad Eestis “päriselt lauale tulla”

Läbipaistvusest enam ei piisa, kui tehisaru hakkab sinu eest otsuseid tegema valdkondades, mis mõjutavad inimeste elu. Sellisteks valdkondadeks on näiteks haridus, personalitöö (HR), ligipääs avalikele teenustele või kriitiline taristu.

Tõlgendus lugejale: “Kui AI aitab otsustada inimese töö, õppe või ligipääsu üle teenustele, siis tõuseb risk ja nõuded.”

Statistikaameti andmetel kasutas 2023. aastal 14% Eesti ettevõtetest tehisaru, mis on peaaegu kolm korda rohkem kui aasta varem. 2025 aasta arvud on veel suuremad ning 2026 aastal tõuseb see usutavasti hüppeliselt. Trend on selge ja see tähendab, et ka kõrge riskiga lahendused jõuavad varem või hiljem paljude lauale. Loe lähemalt siit, kuidas tehisaru Eesti ettevõtetes levib. Seega on oluline mõista, milliseid andmeid sa oma AI-süsteemidesse üldse sisestada tohid, millest oleme kirjutanud siin: Andmekaitse ja AI: mida sa ei tohi tehisarule anda.

Ajajoon 2026: mida jälgida ja miks just nüüd tegutseda

Tähtajad tunduvad kaugel, aga tehisaru maailmas liiguvad asjad kiiresti. On mõistlik alustada ettevalmistustega juba täna.

Mis muutub 2026. aastal (praktiliselt)?

2. august 2026 on kuupäev, mil suur osa AI Acti reeglitest hakkab kehtima ja järelevalveasutused alustavad nende jõustamist. Samal ajal jätkub ka täpsustavate juhendite ja suuniste väljatöötamine, eriti kõrge riskiga süsteemide osas. See tähendab, et reeglid muutuvad ajas veelgi selgemaks.

Miks Eesti ettevõte ei peaks ootama, “kuni kõik on 100% selge”?

Ootamine ei ole parim strateegia. Riskipõhine mõtlemine on kasulik juba praegu. AI kasutuse inventuuri tegemine, läbipaistvuse tagamine ja sisereeglite loomine aitavad vähendada vigu, andmekaitseriske ja kasvatada klientide usaldust, sõltumata seaduse lõplikest detailidest.

Kui kasutad juba täna generatiivset tehisaru kliendisuhtluses või sisuloomes, on Artikli 50 läbipaistvuspõhimõtete rakendamine lihtsalt hea äritava. See näitab, et oled vastutustundlik ja aus ettevõte.

Praktiline kontroll: kas sinu AI kasutus võib langeda “limited” või “high-risk” alla?

Teeme kiire enesehindamise. Vasta nendele küsimustele ausalt, mõeldes oma ettevõtte tegevustele.

Kiirküsimused (lugeja enesehindamine)

- Kas klient, õpilane või töötaja suhtleb sinu ettevõttega otse tehisaru kaudu (näiteks juturobot, hääleassistent)?

- Kas sa avaldad tehisaruga loodud või muudetud pilte/videoid, mis võivad näida pärisena (näiteks turunduses või sotsiaalmeedias)?

- Kas tehisaru aitab sinu ettevõttes teha otsuseid inimeste kohta (näiteks värbamisel, tulemuste hindamisel, teenusele ligipääsu andmisel)?

Tulemuste tõlgendamine (lihtne)

- Kui vastasid “jah” esimesele kahele küsimusele: Sinu jaoks on kõige olulisemad läbipaistvuse ja märgistamise reeglid. Need on piiratud riski (limited risk) kohustused, mis on lihtsasti täidetavad.

- Kui vastasid “jah” kolmandale küsimusele: Ole tähelepanelik! See viitab potentsiaalsele kõrge riski (high-risk) suunale. Peaksid planeerima põhjalikuma dokumentatsiooni, selged protsessid ja tagama inimjärelevalve, isegi kui lõplik hinnang vajab juristi abi.

Mida ettevõte peab tegema 2026. aastal: samm-sammuline tegevusplaan

Unustame teooria ja läheme konkreetseks. Siin on praktiline tegevuskava, millega saad kohe alustada.

Samm 1: AI inventuur (1 nädal)

- Tee nimekiri: Pane kirja kõik kohad, kus sinu ettevõte kasutab tehisaru – turundus, klienditugi, personalitöö, analüütika, sisemised tööriistad.

- Kirjelda iga kasutusjuhtu: Mis tööriista kasutatakse? Milliseid andmeid sinna sisestatakse? Mida selle väljundiga tehakse? Kas see mõjutab otseselt mõnda inimest?

Samm 2: Riskiklassi esmane määramine (1–2 päeva)

- Jaota kasutusjuhud: Kasuta oma nimekirja ja jaga tegevused kolme gruppi: minimaalne, piiratud (vajab läbipaistvust) või võimalik kõrge risk (otsused inimeste kohta).

- Märgi punased lipud: Tõmba joon alla kõigele, mis on seotud biomeetria, emotsioonituvastuse, süvavõltsingutega või automatiseeritud otsustega.

Samm 3: Läbipaistvuspakett (Artikkel 50) – “tee see korda kohe”

- Lisa teavitus: Veendu, et iga juturoboti või AI-assistendi juures oleks selge märge, et tegemist on masinaga.

- Lisa märgistus: Kui kasutad AI-ga loodud pilte või videot, lisa neile märge (nt “AI-genereeritud illustratsioon”).

- Loo sisereegel: Lepetage meeskonnas kokku, kuidas ja millal sisu märgistada, et see oleks ühtne üle kõikide kanalite.

Samm 4: Kõrge riski eeltöö (kui tegutsed HR-is, hariduses, finantsvaldkonnas vms)

- Küsi tarnijalt: Kui kasutad kellegi teise loodud kõrge riskiga süsteemi, küsi neilt tehnilist dokumentatsiooni ja infot vastavushindamise kohta.

- Pane paika protsess: Taga, et alati oleks olemas inimjärelevalve, võimalus otsuseid vaidlustada ja et kõik tegevused logitaks.

- Kui oled ise pakkuja: Kui ehitad ise kõrge riskiga AI-lahendust, pead planeerima põhjaliku vastavushindamise ja dokumentatsiooni loomise.

Samm 5: Sisereeglid ja koolitus (2–4 nädalat)

- Loo AI kasutuspoliitika: Pange kirja, milliseid andmeid ei tohi kunagi AI-süsteemidesse sisestada, millised on heakskiidetud tööriistad ja et kliendile minev sisu vajab alati inimkinnitust.

- Koolita oma tiimi: Räägi kõigile läbipaistvuse ja märgistamise reeglitest, riskidest (nagu valeväited või kallutatus) ja sellest, kelle poole küsimustega pöörduda.

Samm 6: Tõendus ja auditijälg (pidev)

- Hoia kõik alles: Säilita oma kasutusjuhtude register, riskihinnangud, otsused märgistamise kohta ja info koolituste läbimise kohta.

- Eesmärk: Kui keegi kunagi küsib, “miks te nii tegite?”, pead suutma näidata oma protsessi ja otsuste tagamaid.

Põhjalikuma ülevaate ja näidisplaani leiad meie juhendist: tehisintellekti juurutamise tegevuskava ettevõttes.

Näited Eesti ettevõttele (et saaksid päriselt aru)

Teooria on üks asi, aga vaatame, kuidas see praktikas välja näeb.

Näide 1: Klienditoe juturobot e-poes

- Mis risk? Kuna kasutaja suhtleb otse tehisaruga, on teavitamine kohustuslik. Vastasel juhul võib tekkida segadus ja kliendi halb kogemus.

- Mida teha? Lisa juturoboti tervitusteksti selge märge, näiteks “Tere, olen sinu AI-assistent!”. Paku alati selgelt nähtavat võimalust suhelda päris inimesega (“Räägi inimesega” nupp).

Näide 2: AI-turundus (tekst + pildid)

- Mis risk? Kui lood tehisaruga pildi, mis näeb välja nagu päris foto inimesest või sündmusest, võid avalikkust eksitada.

- Mida teha? Lisa pildile väike märge, näiteks “AI-loodud illustratsioon”. Loo sisemine reegel, mis ütleb, millal ja kuidas sellist sisu märgistada.

Näide 3: HR-is CV-de sõelumine või kandidaatide skoorimine

- Mis risk? See on klassikaline kõrge riski näide, kuna tehisaru otsused mõjutavad otseselt inimeste võimalusi tööle saada. Siin on vaja rangemat kontrolli.

- Mida teha? Tagada, et lõpliku otsuse teeb alati inimene. Dokumenteeri, milliste kriteeriumide alusel AI kandidaate hindab. Paku kandidaatidele võimalus otsus vaidlustada ja küsi oma tarkvara tarnijalt vajalikku dokumentatsiooni.

KKK (FAQ) – lugejate tüüpküsimused

Lõpetuseks vastame mõnele korduma kippuvale küsimusele.

“Kas AI Act kehtib ka siis, kui ma lihtsalt kasutan ChatGPT-d?”

Jah, kui sa kasutad sellega loodud sisu oma ettevõtte nimel avalikult. Kui avaldad tehisaruga loodud teksti, pildi või video, kehtivad sulle läbipaistvuse ja märgistamise põhimõtted (Artikkel 50). Asi pole tööriistas, vaid selles, mida sa selle väljundiga teed.

“Kas see on sama mis GDPR?”

Ei, need on kaks eri asja, kuigi sageli käivad käsikäes. GDPR kaitseb isikuandmeid, AI Act aga reguleerib tehisaru süsteemide kasutamisega kaasnevaid riske. Kui sinu tehisaru töötleb isikuandmeid, pead järgima mõlema seaduse nõudeid.

“Mis on kõige mõistlikum ‘esimene samm’ 2026. aastal?”

Tee oma ettevõttes AI inventuur ja kehtesta kohe Artikli 50 läbipaistvuse reeglid. See tähendab, et lisa vajalikud teavitused ja märgistused. Need on kõige universaalsemad ja lihtsamini rakendatavad sammud, mis annavad kohe praktilist kasu.

Arenda oma Tehisaru teadmisi ja ole tulevikuks valmis. Meie platvorm pakub sulle tööriistu, juhendeid ja kogukonna tuge, et saaksid tehisintellektist maksimumi võtta. Liitu kogukonnaga siin