Sissejuhatus: tehisaru kasutamine ja eetika = usaldus, mis kestab

Mõtle tehisaru kasutamise eetikast kui oma ettevõtte digitaalsest käepigistusest. See ei ole keeruline teadus, vaid lihtne ja aus mängureegel: inimesed tahavad teada, kelle või millega nad suhtlevad. Kui sinu veebilehel tervitab klienti juturobot, on aus see ka välja öelda. Just see läbipaistvus on pikaajalise usalduse vundament, mis eristab sind konkurentidest ja loob klientidega püsiva suhte.

Selle postituse eesmärk on anda praktiline raamistik: millal peab AI kasutust avaldama, kuidas vältida eksitamist ning miks vastutus jääb alati inimesele (ja organisatsioonile). Lühike tees: läbipaistvus ei ole “ilus lisand”, vaid usalduse (ja paljudes olukordades ka nõuete) eeltingimus, eriti kui inimene suhtleb AI-ga või tarbib AI-genereeritud sisu.

Tehisaru kasutamine ja eetika sisukord

Põhimõtted: 4 eetilist sammast, millest otsused lähtuvad

Tehisaru eetilise kasutamise maailm võib esialgu tunduda keeruline, aga tegelikult toetub kõik neljale lihtsale ja loogilisele põhimõttele. Mõtle neist kui oma kompassist, mis aitab sul alati teha selgeid ja usaldust kasvatavaid otsuseid.

Läbipaistvus (transparency): “inimene peab teadma, millega ta suhtleb”

Kõige olulisem sammas on läbipaistvus. Lihtsalt öeldes tähendab see, et inimene peab aru saama, kas ta räägib teise inimese või masinaga. Ka OECD AI põhimõtted ütlevad, et läbipaistvus ja selgitatavus on usaldusväärse AI alustalad. Ka EL-i tehisintellekti määruse (AI Act, artikkel 50) seab teatud juhtudel läbipaistvuskohustused: kasutajale tuleb öelda, kui ta suhtleb AI-süsteemiga, ning AI-genereeritud või -manipuleeritud sisu peab olema selgelt märgistatud. Praktikas tähendab see, et teavitad klienti või lugejat õigel hetkel (enne suhtlust või selle alguses), mitte ei peida infot kuhugi lehe jalusesse.

Näiteks kui avad veebilehel vestlusakna, mis ütleb: “Tere! Olen sinu virtuaalne abiline. Kuidas saan aidata?”, ongi läbipaistvuse nõue täidetud. Sa tead kohe, et suhtled algoritmiga, ja oskad oma ootusi vastavalt seada.

Autorlus (authorship): “kes tegelikult vastutab loodud sisu eest”

Eetiline autorlus tähendab, et inimene ei esita AI toodangut enda originaal-loominguna, kui AI panus oli sisuline (mitte ainult keeleline toimetus). Tehisaru on võimas tööriist, aga vastutust selle väljundi eest ei saa kunagi anda algoritmile. “Autori” roll on ka toimetuslik: inimene valib, kontrollib, täiendab ja võtab vastutuse lõpptulemuse eest, isegi kui mustand tuli AI-lt.

Vastutus (accountability): “algoritmi või tarnija taha ei saa peituda”

Läbipaistvus ilma vastutuseta on tühi sõnakõlks. Kui midagi läheb valesti, ei saa öelda, et “algoritm tegi”. NIST AI riskijuhtimise loogikas käivad läbipaistvus ja vastutus koos: ilma nähtavuseta ei saa vastutust rakendada ning ilma vastutuseta on läbipaistvus jõuetu. Sinu organisatsioon peab määrama rollid (kes on omanik, kes teeb kontrolli, kellele probleemist teada anda?) ja looma auditeeritava jälje (mida kasutati, miks otsustati nii).

Näiteks kui kasutad AI-d laenutaotluste esmaseks hindamiseks, tuleks protsess ehitada nii, et AI annab soovituse, aga lõpliku “jah” või “ei” ütleb inimene. Lisaks peab olema dokumenteeritud, milliseid kriteeriumeid AI kasutas, et saaksid vajadusel kliendile otsust selgitada.

Usaldus (trust): “pikaajaline suhe, mitte lühiajaline võit”

Lõpuks on kõige olulisem sammas usaldus. See tekib siis, kui inimene tunneb, et teda ei eksitata, tema andmeid austatakse ja süsteem käitub prognoositavalt ning turvaliselt. Eetika “tasuvus” tuleb maine- ja riskijuhtimisest: üks eksitav AI-vastus või varjatud deepfake (süvavõltsing) võib rikkuda brändi usalduskapitali kiirelt.

Millal peab AI kasutust avaldama? (praktilised reeglid)

Teooriast praktikasse. Millal sa siis päriselt pead ütlema, et mängus on tehisaru? Siin on neli selget olukorda, kus AI kasutamise avalikustamine pole lihtsalt hea tava, vaid lausa kriitilise tähtsusega.

1) Kui inimene suhtleb AI-ga (chatbot, kõnebot, assistent)

See on kõige selgem reegel. EL-i tehisintellekti määruse (AI Act, artikkel 50) järgi peab kasutajat teavitama, kui ta suhtleb otse AI-süsteemiga. Hea tava on öelda kohe alguses “See on automatiseeritud assistent” ja anda selge tee inimeseni (“Soovin suhelda inimesega”). See vähendab frustratsiooni ja näitab, et sa ei peida end tehnoloogia taha.

2) Kui sisu on AI-genereeritud või -manipuleeritud (eriti visuaal ja video)

See on eriti oluline deepfake’ide ehk süvavõltsingute ajastul. EL-i tehisintellekti määrus käsitleb ka AI-genereeritud või -manipuleeritud sisu märgistamist. Praktiline standard on lihtne: kui visuaal või video võib tekitada mulje, et see on päris sündmus või inimene, märgista see nähtavalt. See ei pea olema suur hoiatus, tihti piisab väikesest märkusest pildi all, näiteks “AI-ga loodud illustratsioon”.

Näiteks kui turunduskampaanias kasutatakse AI-ga loodud pilti, mis näeb välja nagu foto päris inimesest, tuleb see selgelt märgistada. See hoiab ära eksitamise ja näitab, et oled oma suhtluses aus.

3) Kui AI mõjutab otsust, õigusi või ligipääsu (avalik sektor, haridus, töö)

Kui AI sisend mõjutab hinnet, teenuse saamist, järjekorda, toetust, sanktsiooni või valikut, on läbipaistvus ja selgitatavus eriti kriitilised. Sellisel juhul pead suutma selgitada AI rolli (“AI soovitab, inimene otsustab”), kirjeldama süsteemi piiranguid ja pakkuma võimalust otsus vaidlustada. Mida suurem on otsuse mõju inimese elule, seda suurem peab olema läbipaistvus.

4) Kui AI loob sinu nimel “autoriteetse” mulje (ekspertnõuanded, poliitikad, meditsiin, juriidika)

Kui lugeja võiks sinu teksti võtta professionaalse nõuandena, peab inimene tegema tugevama kontrolli ja vajadusel avaldama, et AI oli abivahend. Riskijuhtimine on siin lihtne: “mida suurem mõju, seda suurem läbipaistvus ja inimkontroll”. Lõppkokkuvõttes vastutad sina, mitte tööriist.

“Tee nii / ära tee nii” näited (sisu, pildid, kliendisuhtlus)

Vaatame koos läbi mõned igapäevased olukorrad ja paneme paika konkreetsed soovitused, mis aitavad sul õigeid valikuid teha.

Turundussisu ja blogi

- Tee nii: Kasuta AI-d mustandi loomiseks, aga lisa alati oma kogemus ja kontrolli faktid. Võid lisada lühikese märkuse, näiteks: “AI aitas luua mustandi; lisasime oma kogemuse, näited ja kontrollisime faktid.” Erista alati faktid ja arvamused ning lisa allikad.

- Ära tee nii: Ära avalda üldsõnalist AI-artiklit “eksperdi juhendina” ilma toimetuse ja faktikontrollita. See kahjustab sinu mainet ja võib levitada valeinfot.

Pildid, illustratsioonid, “enne–pärast” ja deepfake-risk

- Tee nii: Märgista AI-ga loodud pilt (nt “AI-generated illustration”), eriti siis, kui see võiks olla tõlgendatav päris fotona. Kasuta AI visuaale kui illustratsioone, mitte tõendusmaterjalina.

- Ära tee nii: Ära kasuta AI-l loodud “inimfotot” justkui päris kliendina või tema kogemusloo illustratsioonina. See on eksitav ja hävitab usalduse.

Näiteks kui lood blogipostituse jaoks pildi õnnelikust perest, on “AI-ga loodud illustratsioon” täiesti sobiv. Aga kui kasutad sama pilti oma toote arvustuse juures, justkui tegu oleks päris kliendiga, on see juba selge eksitamine.

Kliendisuhtlus (chat, e-post, kõned)

- Tee nii: Ütle kliendile kohe, kui ta suhtleb AI-ga, ja anna alati sujuv võimalus suhelda inimesega. Logi olulised otsused ja säilita jälg sellest, mis kliendile lubati ja kes selle kinnitas.

- Ära tee nii: Ära lase AI-l teha lubadusi (näiteks tähtaegade või kompensatsioonide kohta) ilma inimkinnituseta. Sellised vead võivad tekitada juriidilisi probleeme.

Haridus (õppimine, hindamine, juhendamine)

- Tee nii: Sõnasta selged reeglid, millal AI kasutus on õppetöös lubatud ja kuidas sellele tuleb töödes viidata. See aitab vältida segadust ja akadeemilist petturlust.

- Ära tee nii: Ära kasuta AI-d õpilaste hindamisel “musta kastina”, mille otsuseid ei saa selgitada ega vaidlustada. Hindamine peab jääma alati inimkeskseks ja põhjendatuks.

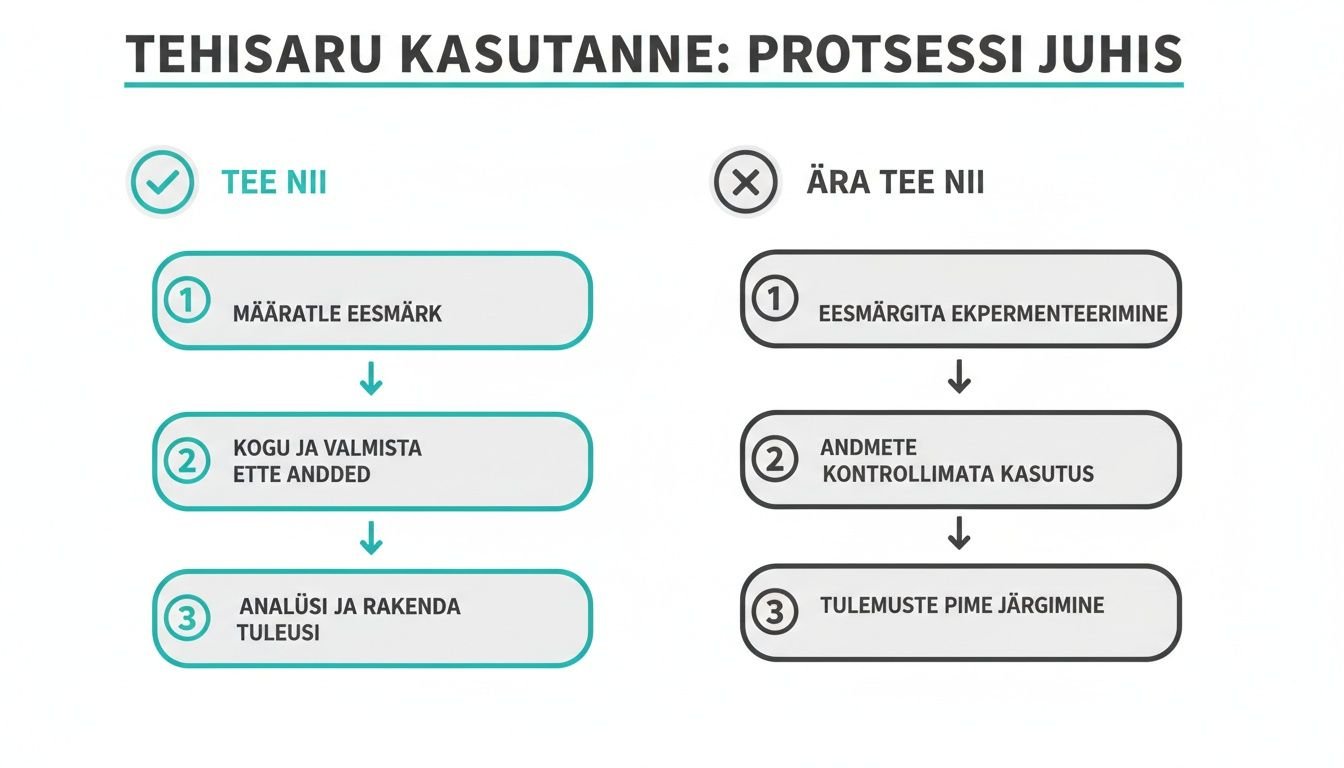

Kuidas vältida eksitamist: praktiline “eetika töövoog”

Eetikareeglite rakendamine ei pea olema keeruline. Tegelikult piisab kolmest läbimõeldud sammust, et luua kogu oma meeskonnale selge ja lollikindel töövoog.

1) Märgista interaktsioon ja sisu õigel tasemel

Vali märgistuse vorm vastavalt olukorrale: vestluses sobib selleks tervitustekst, sisus autorimärge või rida “Kuidas see sisu loodi”, pildi puhul aga selge märge pildiallkirjas. Hoia teade alati eristatav ja arusaadav, mitte peidetud.

2) Inimkontroll enne avaldamist (eriti kõrge mõjuga teemad)

Loo lihtne reegel: “AI väljund on mustand”, mis läbib alati toimetuse, faktikontrolli ja vajadusel juriidilise kontrolli. Kehtesta ka “stopp-sõnad”: kui tekst sisaldab nõuandeid tervise, juriidika või finantside kohta, tuleb see alati suunata inimesest eksperdile ülevaatamiseks.

Näiteks kui AI koostab artikli investeerimise põhitõdedest, peab selle enne avaldamist üle vaatama finantsekspert. See tagab sisu korrektsuse ja kaitseb nii lugejat kui ka sinu ettevõtet.

3) Dokumenteeri: kes vastutab ja kuidas otsus sündis

Määra igale protsessile omanik (content owner või process owner), kes on lõppvastutaja. Hoia lihtsat logi (mis viipa ehk prompti kasutati, mis versiooniga oli tegu, millised olid inimese tehtud muudatused), et oleks võimalik hiljem otsuseid põhjendada ja protsesse parandada.

Organisatsiooni tasand: eetika poliitika “miinimumkomplekt”

Unusta 50-leheküljelised dokumendid. Sinu eesmärk on luua lihtne ja selge juhend, mis annab igale töötajale kindlustunde. See on sinu meeskonna kompass.

- Läbipaistvusreeglid: Millal peab avaldama AI kasutuse (juturobot, deepfake, otsuseid mõjutav AI)?

- Rollid ja vastutus: Kes kinnitab sisu, kes teeb kontrolli, kes reageerib probleemidele?

- Kvaliteedi- ja riskireeglid: Millistes teemades on AI kasutus piiratud või nõuab kohustuslikku inimkontrolli?

- Koolitus: Kuidas vältida eksitamist, kuidas sisu märgistada ja millal küsida abi?

Liitu Eesti AI kogukonnaga (BETA), ja aita ülesse ehitada kogukond ning platvorm kus Eesti inimesed saaksid õppida, kuidas tehisintellekti nutikalt ja turvaliselt enda kasuks tööle panna ning kasutada AI tööriistu ilma, et peaksid maksma kalleid kuutasusid mitmetele erinevatele platvormidele!

Suhtle jututubades teiste Eesti AI huvilistega, küsi nõu / anna nõu, avasta uusimaid AI tööriistu, praktilisi tehisaru juhendeid ning palju muud!

NB! Esimesele 1000 liitujale eluagne tasuta sissepääs!

KKK (FAQ)

“Kas ma pean alati ütlema, et kasutasin AI-d?”

Mitte igas olukorras ühtemoodi, kuid kui inimene suhtleb AI-ga või sisu on AI-genereeritud/-manipuleeritud (eriti deepfake-riskiga), on läbipaistvus sageli nõutav ja praktiliselt vältimatu. Mõtle sellele kui ausale mängule – sa ei taha ju, et su kliendid tunneksid end petetuna.

“Kui AI tegi mustandi ja mina toimetasin, kes vastutab?”

Vastus on lihtne: vastutus jääb alati inimesele ja organisatsioonile, kes sisu avaldas või otsuse tegi. Seda ei saa “delegeerida” tööriistale. Sina oled kapten, AI on sinu kompass – lõpliku otsuse ja vastutuse kannad alati sina.

“Kuidas vältida, et läbipaistvus ei tekitaks usalduskriisi?”

See on levinud hirm, aga tegelikult kasvatab õigesti tehtud avatus usaldust. Sõnasta see kui kvaliteediprotsess: “AI aitas kiirendada mustandit, inimene kontrollis ja vastutab”. Selline lähenemine ei näita sind nõrgana, vaid targana. See näitab, et kasutad parimaid vahendeid parima tulemuse saavutamiseks, mille eest seisab lõpuks hea inimene.

Tee eetika lihtsaks ja nähtavaks

Loo üheleheküljeline “AI läbipaistvuse ja vastutuse” reeglistik: millal avaldada, kes kinnitab, millal küsida abi. Lisa oma sisuloome protsessi kolm kohustuslikku kontrolli: faktid, lubadused ja märgistus (kui AI roll on sisuline).

Kui soovid süveneda tehisaru turvalisse kasutamisse, loe edasi meie teistest artiklitest: “Tehisaru kasutamine turvaliselt: andmekaitse, konfidentsiaalsus ja mida mitte kunagi sisestada”.